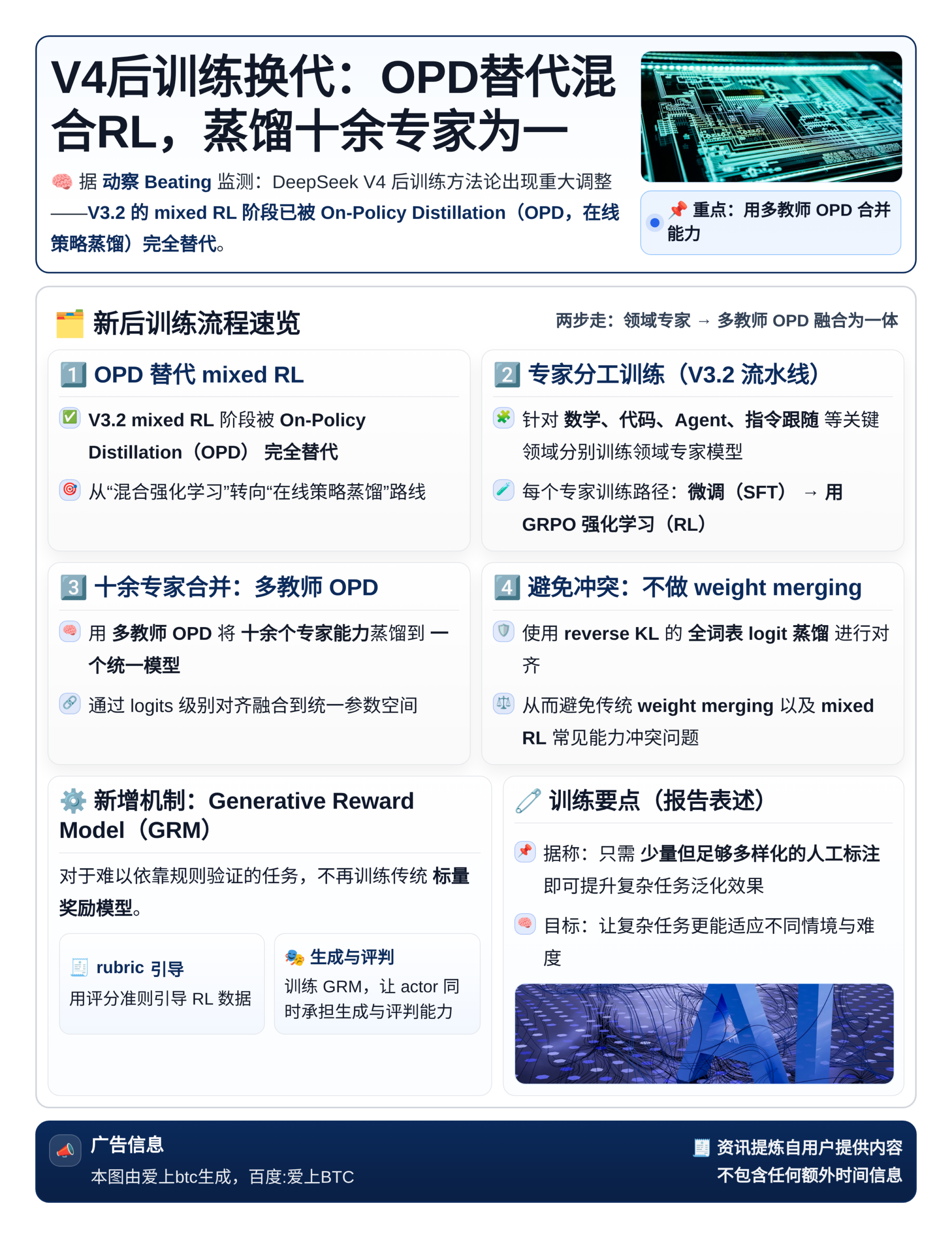

据[动察 Beating](https://t.me/OneMillion_AI)监测,DeepSeek V4 的后训练方法论出现了重大调整:**V3.2 中的 mixed RL 阶段已被 On-Policy Distillation(OPD,在线策略蒸馏)完全替代**。

—

## 新后训练流程:两步走

### 第一步:领域专家分工训练

针对数学、代码、Agent、指令跟随等关键领域,团队在 **V3.2 流水线**基础上,分别训练**领域专家模型**。

每个专家的训练路径为:

1. **微调(SFT)**

2. **用 GRPO 进行强化学习(RL)**

最终形成多个覆盖不同能力维度的专家模型。

—

### 第二步:用多教师 OPD 蒸馏合并能力

接着,团队使用**多教师 OPD**,将十余个专家的能力蒸馏到**一个统一模型**中。

具体做法是:

– 学生模型在**自身生成的轨迹**上,为每个教师进行

**reverse KL 散度**的**全词表 logit 蒸馏**;

– 通过 **logits 级别的对齐**,把多个专家的能力权重融合到统一参数空间;

– 从而避免传统 **weight merging** 以及 **mixed RL** 常见的能力冲突问题。

—

## 新增机制:Generative Reward Model(GRM)

报告还提出 **Generative Reward Model(GRM,生成式奖励模型)**:

对于难以依靠规则验证的任务,不再训练传统的**标量奖励模型**。

而是改用:

– **rubric(评分准则)引导**的 RL 数据

– 训练 GRM,使 actor 网络能够**同时承担生成与评判能力**

据称:只需**少量但足够多样化的人工标注**,就能对复杂任务实现更好的泛化效果。

原创文章,作者:admin,如若转载,请注明出处:https://www.23btc.com/174226/